大數據分析工具全解析 免費與付費選擇指南

在當今數據驅動的時代,大數據分析已成為企業決策與業務優化的核心。無論是初創公司還是大型企業,選擇合適的數據分析工具都至關重要。本文將系統性地介紹當前市場上主流的大數據分析工具,涵蓋免費開源選項與優秀付費解決方案,并探討數據處理的關鍵環節。

一、 免費開源大數據分析工具

免費開源工具以其靈活性、社區支持和低成本優勢,成為許多團隊入門和構建分析體系的首選。

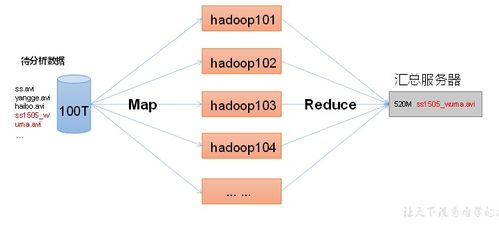

1. Apache Hadoop:

作為分布式處理框架的基石,Hadoop生態系統(包括HDFS, MapReduce, YARN)為海量數據存儲與批處理提供了強大支持。它是構建大規模數據處理平臺的基礎。

2. Apache Spark:

憑借其內存計算引擎,Spark在速度上遠超傳統的MapReduce。它支持批處理、實時流處理、機器學習和圖計算,是當前最活躍的大數據開源項目之一。

3. Apache Flink:

專注于流處理,提供真正的流式處理能力和精確一致的容錯機制,在實時分析場景中表現出色。

4. Elasticsearch + Kibana (ELK Stack):

強大的搜索與分析引擎Elasticsearch,配合數據可視化工具Kibana,構成了日志和指標數據實時搜索、分析與可視化的黃金組合。

5. Apache Kafka:

高吞吐量的分布式消息系統,是構建實時數據管道和流應用的核心,負責數據的可靠采集與傳輸。

6. R 與 Python (Pandas, NumPy, Scikit-learn):

雖然不是端到端的平臺,但R語言和Python及其豐富的數據科學庫(如Pandas, Scikit-learn)是進行數據清洗、探索性分析和建模的利器。

這些工具通常需要較強的技術團隊進行集成、部署和維護。

二、 優秀付費(商業)大數據分析平臺

付費平臺通常提供一體化的解決方案、企業級支持、安全合規保障和更友好的用戶界面,能顯著降低使用門檻并提升效率。

- AWS, Azure, GCP 云數據平臺:

- 亞馬遜AWS (Amazon EMR, Redshift, Athena):提供全面的托管Hadoop/Spark服務、數據倉庫和交互式查詢服務,生態成熟。

- 微軟Azure (Azure Synapse Analytics, HDInsight):深度集成微軟生態,Synapse Analytics將數據集成、數據倉庫和大數據分析統一起來。

- 谷歌云GCP (BigQuery, Dataproc):BigQuery是完全托管、無服務器的企業級數據倉庫,以極快的SQL查詢速度和易用性著稱。

2. Snowflake:

專為云構建的數據平臺,將存儲、計算和服務分離,提供了極高的彈性、并發性能和易用性,支持跨云部署,是數據倉庫領域的明星產品。

3. Databricks:

由Apache Spark的創始人創建,提供統一的“數據+AI”平臺(Lakehouse架構),優化了Spark的性能和管理,集成了數據工程、數據科學和商業分析工作流。

- Tableau / Power BI (側重分析與可視化):

- Tableau:在數據可視化方面領先,能夠連接多種數據源,通過拖拽式界面快速生成交互式、高質量的儀表板。

- Microsoft Power BI:與Office 365深度集成,提供從數據準備、建模到可視化分享的完整流程,性價比高,企業普及率廣。

5. SAS Viya / IBM SPSS Modeler:

老牌的高級分析與預測建模平臺,提供豐富的統計分析和機器學習算法,在金融、醫療等對模型可解釋性和穩定性要求高的行業廣泛應用。

三、 數據處理:分析流程的核心

無論選擇何種工具,有效的數據處理流程都是成功分析的前提。它通常包含以下關鍵階段:

- 數據采集與集成:從數據庫、API、日志文件、物聯網設備等多源異構系統中收集數據。工具如Kafka, Flume, Sqoop, 以及云服務的Data Pipeline/Azure Data Factory等在此階段發揮作用。

- 數據存儲與管理:將數據存儲在合適的系統中,如分布式文件系統(HDFS)、數據湖(AWS S3, Azure Data Lake)、數據倉庫(Redshift, Snowflake, BigQuery)或NoSQL數據庫(HBase, Cassandra)。

- 數據清洗與轉換:處理缺失值、異常值、格式不一致等問題,并進行聚合、關聯等轉換,為分析做準備。Spark, Pandas, Talend, 以及SQL是常用工具。

- 數據分析與建模:應用統計分析、機器學習算法來發現模式、預測趨勢。Spark MLlib, Python/R庫,以及Databricks、SAS等平臺提供強大支持。

- 數據可視化與洞察呈現:將分析結果通過圖表、儀表板等形式直觀呈現,輔助決策。Kibana, Tableau, Power BI, Superset是典型代表。

四、 如何選擇?

- 評估需求:明確分析的數據規模(GB/TB/PB?)、實時性要求(批量/實時?)、團隊技能(編程能力/業務分析?)和預算。

- 免費工具:適合技術實力強、需要高度定制化、預算有限的團隊或學習研究用途。

- 付費平臺:適合追求開發效率、需要快速上線、缺乏專門運維團隊或對安全、支持有高標準要求的企業。

- 混合策略:常見做法是使用開源工具(如Spark, Kafka)處理核心數據管道,同時采用商業產品(如Snowflake, Tableau)進行數據存儲和前端分析,實現成本與效益的平衡。

總而言之,大數據分析工具的選擇沒有“唯一最優解”。理解免費工具的潛力與局限,認識付費平臺帶來的價值,并結合自身的數據處理需求與技術路線進行綜合考量,才能構建出高效、可持續的數據分析體系。

如若轉載,請注明出處:http://www.cfgtmy.cn/product/1.html

更新時間:2026-05-10 11:52:55